私は、文章作成の手助け、コーディング支援、リサーチの要約など、日常的な作業を絶えずエラーや制限、課金の壁にぶつかることなくこなせる、本当に役に立つ無料のGPT系AIツールの代替を探しています。いくつかの「無料AI」サイトやブラウザ拡張機能を試してみましたが、たいていは機能がごく基本的だったり、スパム的だったり、短いお試し期間の後に主要な機能をサブスクリプションでロックしてしまいます。あなたが実際に使っていて安定してよく動作し、信頼するに値すると感じている、無料の信頼できるGPT風AIサービスやアプリは何ですか? それらを信頼して使い続けられる理由も教えてください。

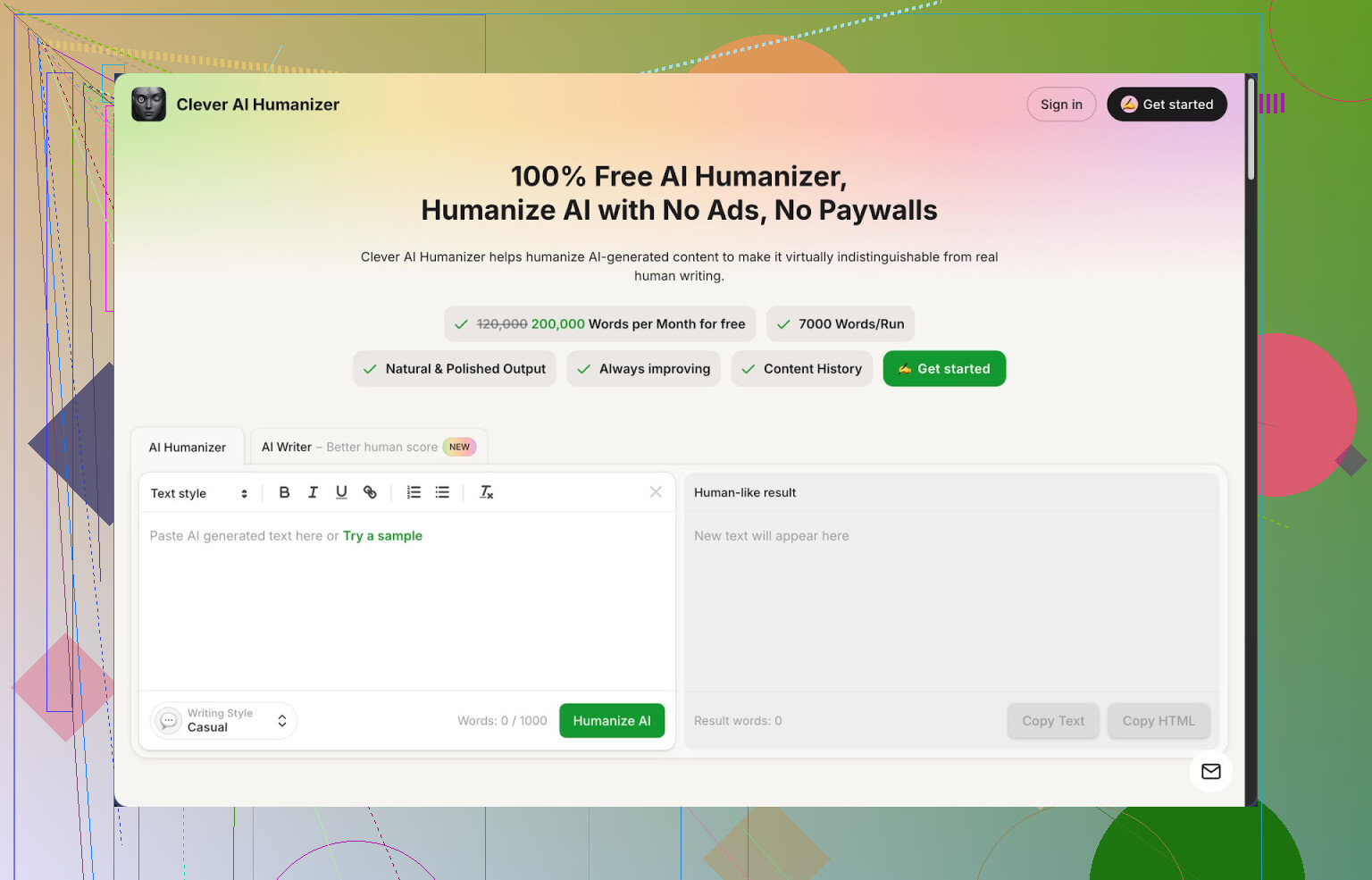

- AI検出フラグにうんざりしてたどり着いた Clever AI Humanizer のレビュー

リンク: Clever AI Humanizer — Best 100% Free Humanizer

いくつもの検出ツールで「100% AI」と表示され続けてうんざりした結果、最終的にたどり着いたのが Clever AI Humanizer でした。AIで少しでも文章を書くなら、あのパターンは見覚えがあるはずです。下書きを検出ツールに貼り付けると警告まみれになり、そのあとクライアントや先生、上司から妙な質問が飛んでくる、という流れです。

そこで、2026年初めのある午後を使ってツールをいくつか検証しました。その中で、ピン留めタブに残したまま使い続けているのが Clever AI Humanizer です。

印象に残った点をまとめます。

無料プランと制限

使っているあいだ、一度も課金の壁に当たりませんでした。クレジット残量も、体験版の残り時間もなし。

無料枠でできたことは次のとおりです。

- 月あたり約200,000ワードまで利用可能

- 1回あたり最大7,000ワードまで処理

- スタイルは3種類:カジュアル、やさしいアカデミック、やさしいフォーマル

- 同じ画面内にAIライター機能を搭載

イメージとして、20万ワードというのは本を一冊書いて、さらにブログ記事をいくつも追加できる分量です。長めの記事を何本か、メールのシーケンス、レポートを数本通しても、まだ余裕がありました。

AI検出テスト

テスト相手として ZeroGPT を使いました。Discord などで名前が挙がることが多いからです。

使った手順は次のとおりです。

- 通常のAIモデルで800〜1,000ワードほどの文章を作成。

- それを Clever AI Humanizer に貼り付け。

- スタイルはカジュアルを選択。

- 変換後の文章を ZeroGPT にかける。

サンプルを3つ用意して試したところ、人間らしく変換された文章は ZeroGPT 上でAI判定が0パーセントでした。一方、変換前の生のAI文章は90〜100パーセントAI判定。ここまで差が出たので、このツールを本気で検証する価値があると感じました。

もちろん、すべての検出ツールが同じ動きをするわけではありませんし、どこかではフラグが立つこともあります。ただ、少なくとも ZeroGPT に関しては、違いがはっきり出ました。

メイン機能:AI Humanizer

核となるツール自体はとてもシンプルです。

- AIで書いた文章を貼り付ける

- カジュアル、やさしいアカデミック、やさしいフォーマルのいずれかを選ぶ

- 数秒待つ

- 新しいバージョンが出てくる

出力結果には、次のような特徴が見られました。

- 同じ言い回しの連発が減る。「この記事では〜を解説します」といったテンプレ表現が消える。

- 文の長さにバラつきが出て、自分が少し疲れているときに書く文章に近いリズムになる。

- 意味はほぼそのまま維持される。技術的な部分を1行ずつ確認しましたが、定義や数値が壊れることはありませんでした。

個人的に大きな利点だったのは、無理やり「クリエイティブ風」の文章にされない点です。ロボット的な構造をほぐし、ところどころを補い、「いかにもAI」なつなぎ言葉から距離を取るのが中心で、過剰な装飾はあまり入りません。

とはいえ、必ず全文を読み返す必要はあります。長文になると、ところどころでソフトな言い換えや、内容の言い直しが入る箇所がありました。軽く流し読みして直せば済みますが、どんなツールでも完全に任せきりにはしない方が安全です。

内蔵AIライター

AIライターは同じダッシュボード内にあります。

トピックを指定して長さを選べば、エッセイ、ブログ記事、一般的な記事などを書いてくれます。そのままワンクリックで Humanizer に流せる構造です。

試したユースケースは次の2つです。

- 学生風エッセイ:リモートワークのメリット・デメリットをテーマに、スタイルをやさしいアカデミックにして執筆 → そのあと Humanizer に通す。検出スコアが下がり、締切前に急いで書いたクラスメイトの文章に近いトーンになりました。

- ニッチなブログ記事:外付けSSDの故障をテーマにカジュアルで執筆 → さらに Humanizer にかけ、掲示板やフォーラムっぽい話し言葉寄りの文体に調整。

複数サイトを行き来しなくていいので、AIで初稿を大量に作ってから整える、という書き方をしている場合に特に時短になります。

文法チェッカー

無料の文法チェッカーは、機能としてはシンプルですが実用的です。

- スペルや句読点の修正

- 二重スペースや余分なカンマなど細かい乱れを整理

- 直訳っぽく読める表現をやや自然にする

時制が混在していたり、カンマが抜けていたり、大文字・小文字がバラバラな文章を投げてみましたが、コーポレート調に寄せ過ぎることなく、大半をうまく整えてくれました。

これは、人間らしく変換した後の仕上げとして特に役立ちました。クライアントに渡したり、公開する前の最終チェックとして使える感覚です。

パラフレーズ機能

無料のAIパラフレーズツールは、単なる言い換えというより「コントロールされた書き直し」に近い印象です。次の3パターンで使いました。

- SEO用途:同じような段落がページ間でかぶらないように微調整する。

- 説明の組み替え:固くて読みづらい説明を、友だちがサブレディットに書き込むような文体に変える。

- トーン調整:やさしいアカデミックで書かれた文章を、カジュアル寄りに崩す。

こちらも、テストした範囲では意味はきちんと保たれていました。元の文章と並べて確認しても、製品仕様や日付、数値などで事実がずれることはありませんでした。ただし、扱う分野が繊細な場合は、どのみち最終的な読み返しは必要です。

実際のワークフロー

2,500ワードの長文記事での具体的な流れはこんな感じでした。

- 外部のAIモデルで下書きを生成。

- 1,500〜2,000ワードずつ Clever AI Humanizer に貼り、スタイルはカジュアルを選択。

- 変換後の文章を文法チェッカーに通す。

- 少し違和感があったり、膨れすぎた部分をスポット修正。

- それでもまだ硬いセクションだけ、パラフレーズ機能に1回かける。

かかった時間は1本あたり30〜40分ほどで、すべて手書きで書き直すときと比べて1時間以上の作業をだいぶ削れました。

気に入った点

- クレジット残量を気にしなくてよい。カウンターを見張る必要がなくなり、試行錯誤がしやすい。

- 1回あたりの処理上限が大きい。7,000ワードあれば、長いエッセイや1本分のブログ記事を一気に処理できる。

- 変に「クセ強め」な文章を押し付けてこないスタイル設計。カジュアル、やさしいアカデミック、やさしいフォーマルがあれば、日常的な文章は大体カバーできる。

- 文法チェック、書き換え、生成が1つの画面にまとまっており、タブを行き来しなくて済む。

物足りないところ

万能ツールではありません。実際にぶつかった問題としては次のようなものがあります。

- 検出ツールによっては、依然としてAIと判定される。各サイトごとにモデルやバイアスが違うため、Clever AI Humanizer を通したからといって必ずしも安全、とは言い切れない。

- 文章量が増えがち。人間らしくしたテキストは、元より10〜25パーセントほど長くなることがありました。バリエーションや言い回しを増やすことでAIっぽさを減らすという性質上、ある程度は仕方ない部分ですが、厳密な文字数制限がある場合は自分で削る必要があります。

- Reddit のようなカジュアルすぎる場では、少し「整いすぎ」に感じる出力もあったので、あえて小さなクセやタイプミスを戻して、プラットフォームの雰囲気に合わせることもありました。

すべての学術系検出ツールを完全にすり抜けたいなら、最終的には自分の文章や手直しを混ぜる必要があります。自分としては、Clever AI Humanizer をあくまで「強力な土台作りのレイヤー」として扱い、自分の声を完全に置き換えるものとは見ていません。

追加リソース

スクリーンショットや検証結果を含む、より詳しいレビューはこちらにあります。

https://cleverhumanizer.ai/jp/community/t/clever-ai-humanizer-review-with-ai-detection-proof/42

YouTube のレビュー動画はこちらです。

ツール比較の参考になった Reddit のスレッド:

-

おすすめAIヒューマナイザーまとめスレ:

https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=ja -

AI文章を人間らしくすること全般の雑談:

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai/?tl=ja

まとめ

AIで文章を書く量が多く、細かいクレジット制限に疲れているなら、Clever AI Humanizer は2026年時点で、料金を気にせず日常的に回せる数少ないツールの一つでした。最終的な編集からは逃れられませんが、AI検出ツールとの消耗戦や、のっぺりした文体と戦う時間は、かなり減らしてくれます。

制限なしで何でもできる「完全無料のGPTクローン」はまず見つかりませんが、いくつかのツールを組み合わせれば、課金せずかなり近いところまで行けます。

2026年時点でうまく機能するざっくり構成は次のとおりです。

-

汎用チャットボットとコーディング支援

・Perplexity Free:リサーチ要約、リンク取得、ざっくりした説明回答に向いています。

・Gemini Free:コード相談や数学にそこそこ強いです。出力が少し堅いことがあるので、軽く編集するとよいです。

・コード用:VS Code 内でこれらを使う

– GitHub Copilot は学生や一部の組織なら無料。

– Continue.dev 拡張機能は、ローカルモデルや無料のリモートモデルで動作します。 -

ライティングとエッセイ

ここは @mikeappsreviewer の意見と少しだけ異なります。あちらは検出とAI文体の「人間らしさ」調整に重点を置いています。日常の文章作成と、AI判定を避けたいのが主な悩みなら Clever Ai Humanizer は役立ちますが、それだけを唯一のライティングツールとして使うことは勧めません。

実用的な組み合わせ:

・下書きは Gemini か Perplexity に書かせる。

・必要なときにその下書きを Clever Ai Humanizer に通す。たとえば

– ロボットっぽさを抑えたメール

– 意味は保ちつつ、いかにもAIらしい言い回しを避けたエッセイ

– ZeroGPT のような基本的な検出ツールをある程度すり抜けるブログ記事

・最後に自分でざっと見直し。冗長な部分を削り、不自然な言い換えを直す。

人間化ツールは文章量が増えがちなので、この手順なら多くの文字数制限内にも収まりやすくなります。 -

ミスの少ないリサーチ要約

・ここでも Perplexity が有効です。出典を明示してくれるので、リンクから元情報を確認できます。

・ただし、日付や数値は必ず元ソース側で確認してください。どのLLMもときどき幻覚を起こします。

・PDF を扱うときは

– ChatPDF の無料枠 か

– llama.cc のようなビューア上で LlamaParse を使い、構造化された要約を出すと便利です。 -

無課金でやりくりする戦略

次のように使い分けると、使用量が分散され、制限に当たりにくくなります。

・ドラフト作成とコード用に Gemini Free。

・検索とリサーチに Perplexity Free。

・トーン調整と検出回避の摩擦軽減に Clever Ai Humanizer。

現状、このレベルの利用ではクレジットカード登録を強制されることはほとんどありません。 -

Clever Ai Humanizer の位置づけ

以下のような場面で使うとよいです。

・AIで書いた文章が検出ツールで「100% AI」と判定されるとき。

・学校の課題やレポート向けに、シンプルなアカデミック調やフォーマル調が必要なとき。

・1つのタブの中で、AIライター→人間化というワンクリックの流れを作りたいとき。

ただし、「どんな検出ツールも必ずすり抜けられる」と期待して頼り切るのはやめてください。必ず自分の手で編集も混ぜましょう。例え話や事例を、自分の実体験ベースのものに差し替える。文章が長くなりすぎていたら短くする。こうした工夫で自分の声が文章に残り、どんなツールよりも検出フラグを下げることができます。

無制限で完全無料、しかも高性能な「GPTクローン」は存在しません。そんなものがあると言い張る人は、何かを売ろうとしているか、あなたが課金画面にたどり着く前に離脱することを期待しているかのどちらかです。

とはいえ、カードを出さずに「ほぼ有料GPTサブっぽい」環境を組むことは十分可能です。

@mikeappsreviewer と @voyageurdubois が言う「組み合わせ戦略」には概ね賛成ですが、「人間味付けツールが主役」という点にはそこまで同意していません。日常の「これをとりあえず片付けたい」という用途でいちばん重要なのは次の部分です。

1. 雑談+リサーチ+軽いコーディング

-

Perplexity 無料版

「チャット相棒」ではなく「賢い検索エンジン」として使うのがコツ。

得意なこと:- 「Xを5つの箇条書きで、出典付きで説明して」

- 「AとBのツールを、長所と短所込みで比較して」

- 「このPythonコードがXエラーを出す理由は?」のような簡単なコード質問

完璧ではないものの、出典なしの怪しいGPTフロントエンドよりは、リサーチ要約に関してずっと信頼できます。

-

Gemini 無料版

こんな用途なら十分強いです:- メール、エッセイ、ブログ構成案の下書き

- 基本的なコード生成とデバッグ

- 簡単な計算やデータ整理の手伝い

弱点は「文体」。固かったり、いかにもなテンプレ感が出がちです。ここに人間味付けのレイヤーが効いてきます。

2. 無料でコーディング支援を受ける

コードを書く比率が高いなら:

-

Continue.dev(VS Code拡張)

ローカルLLaMAなどのローカルモデルや公開エンドポイントなど、無料・オープンなモデルをつなげられます。

得意なこと:- エディタ内インライン補完

- 「この関数の説明をして」

- 基本的なリファクタリング

GPT-4ほど洗練されてはいませんが、料金は0円です。

-

条件を満たすなら、学生や一部組織向けの GitHub Copilot 無料枠 も選択肢。それが無理なら、上の組み合わせに戻る感じです。

「チャットで聞いてコピペすればいいじゃん」という意見には少し反対です。そこそこの規模のコーディングになると、AIがエディタの“中にいる”ことの影響は、世間が思っているよりずっと大きいです。

3. 「AIが書きました感」が出ない文章づくり

ここで Clever Ai Humanizer に出番があります。ただし、人が夢見るような「全部の検出器を必ずすり抜ける魔法ツール」という意味ではありません。

現実的な使い方は:

- まず Gemini や Perplexity で下書きを作る

- その下書きを Clever Ai Humanizer に入れる:

- 文脈に応じて Casual / Simple Academic / Simple Formal を選ぶ

- そこで:

- ロボっぽいパターンを崩す

- 文の長さにリズムを持たせる

- 「私はAI言語モデルとして…」系の不要文を消す

いちばん大きい価値は、「検出器を100%回避」ではなく、トーンと流れ を人寄りにすることです。ZeroGPTとの相性が良いという @mikeappsreviewer の指摘は事実として面白いですが、それはあくまで検出器の一つに過ぎません。自分としては、「意味をあまり崩さずに、LLM特有の繰り返し感を削ってくれる」点のほうを重視しています。

@voyageurdubois へのちょっとした反論としては、日常のメールやレポートなら、Clever Ai Humanizer をかなり積極的に使っていい と考えています(その後、自分でざっとチェックする前提で)。カジュアルな日常用途ならそれで十分です。ただし、ガチな学術論文や法律文書では、AIだけで完結させて「十分」と言えるものはありません。

4. なるべく破綻しないリサーチ要約

エラー率を減らしたいなら:

- Perplexity をこう使う:

- 「この3つのリンクを要約して」

- 「2024/2025年時点のXの状況を教えて」

- PDFがある場合:

- ChatPDF などに投げて、ピンポイントな質問をする

- 何かが“妙に自信満々”に聞こえたら、必ず元のPDFで確認する

そして面倒な真実として、数字・引用・“きれいすぎる話” は、人間が自分の手で検証しなければなりません。ここをサボるなら、間違った情報を出すリスクをそのまま飲み込むことになります。

5. 常に課金画面に追い込まれないようにする

1つのツールだけを限界まで酷使して制限を踏むのではなく、役割分担させます:

- Gemini 無料版 を、主に下書き作成とコーディング用に使う

- Perplexity 無料版 を、リサーチやWeb前提の質問に使う

- Clever Ai Humanizer は次のような時に使う:

- 出力がロボっぽくて、もっと自然な言い回しにしたいとき

- いかにもAI風の表現が、シンプルな検出器に引っかかりそうなとき

- 文法チェックとパラフレーズを一気にやりたいとき

このように負荷を分散させれば、だいたいのケースで無料枠の上限に引っかかりにくくなります。無制限ではありませんが、学生 / 個人開発者 / ブロガー程度の利用なら、十分やっていけます。

6. Clever Ai Humanizer の本当の立ち位置

こんな場合に使うのが現実的です:

- すでにAIで書いたテキストを:

- 普通の人が話すような自然なトーンにしたい

- 同じ表現の繰り返しを減らしたい

- 構成を少し柔らかくしたい

- 1つのタブで次のような機能をまとめて使いたいとき:

- Humanizer

- パラフレーズ

- 文法チェック

- 簡易ライティング機能

逆に、次のような期待は持たないほうがいいです:

- すべての文を魔法のように「完全非検出」に変えてくれる

- 自分の推敲を完全に代替してくれる

- もともと内容がボロボロの原稿を救ってくれる

イメージとしては、

「LLMの出力 → Clever Ai Humanizer → 自分でサッと最終チェック」

であって、

「LLM → そのまま提出」

ではありません。

この「最後の10〜20%の編集」を自分でやる覚悟があるなら、Gemini + Perplexity + Clever Ai Humanizer の組み合わせは、「有料GPT環境にかなり近い使い心地」を、リミットやサブスク画面に毎回悩まされずに実現してくれます。

「本当に“無料のGPT代替”に近いもの」が欲しいなら、1つの魔法みたいなアプリを探すのではなく、レイヤー構造で考える必要があります。@voyageurdubois / @vrijheidsvogel / @mikeappsreviewer が言う「ツールを積み重ねる」発想には同意ですが、重心は少しずらしたいです。

彼らは主に以下に最適化しています:

- リサーチ(Perplexity)

- 下書き作成(Gemini)

- ロボットっぽさの除去(Clever Ai Humanizer)

ここに第4の柱として「ローカル / オープンモデル」を足しつつ、人間味付けツールの得意分野について、もう少し正直さを加えたいと思います。

1. 一つのサイトに依存しない中核セットアップ

Gemini と Perplexity だけの中で完結させる代わりに:

- ローカルLLM用フロントエンド

- LM Studio や Ollama と 7B〜14B クラスのモデルを組み合わせるイメージ。

- 長所:オフライン可、アカウント不要、一般的なチャット・ブレスト・ざっくりしたコードには日次上限が実質なし。

- 短所:そこそこのマシンが必要、事実ベースにはやや弱い。

これを次の用途で使う:

- アイデア出し:「このブログ記事の切り口を10個出して」

- 定型文:「汎用的なプライバシーポリシー案を書いて。法律部分は自分で直す」

- ちょっとしたリファクタ:「この関数をもっと読みやすく書き直して」

そのうえで、次のように使い分ける:

- Perplexity:リアルタイムのWeb情報+出典が本当に必要なときだけ。

- Gemini:難しめのコードや、構造化された文章を書かせたいときの「一段強いモデル」として。

こうすると、大量のトラフィックは無料クラウド枠ではなくローカルモデル側に流れるようになります。

2. Clever Ai Humanizer が本当に役立つ場面

機能の説明は他の人がしているので、「いつタブを開く価値があるか」という観点でだけ整理します。

Clever Ai Humanizer を使うべきなのは:

- AIの出力は気に入っているが、

- 決まり文句を繰り返している

- 「いかにもLLM」っぽく聞こえる

- メールやレポートにしては固すぎる

- トーンを素早く切り替えたいとき:

- 技術文 → シンプルなアカデミック調

- かしこまった文 → 社内向けのややカジュアルな文

- 低リスクな場面で、安っぽいAI検出ツールに「100% AI」判定を食らって鬱陶しいとき

Clever Ai Humanizer の長所:

- 無料枠の文字数と1回あたりの制限がかなり寛大で、日常的にちゃんと使える。

- スタイルがまとも:カジュアル、シンプルアカデミック、シンプルフォーマルなど、ネタ系の「シェイクスピア風」みたいなモードに寄っていない。

- 文法チェック+言い換え+ライター機能が同居しているので、

他ツールで下書き → Humanizer → 文法 → 仕上げの微修正

まで1カ所で回せる。 - 実際、「GPTっぽいリズム」をかなり落としてくれる。文構造を変えたり、テンプレ表現を削ったりしてくれる。

Clever Ai Humanizer の短所:

- 文章を長くしがち。厳密な字数制限がある場合は自分で削る必要がある。

- テキストが完全に検出不能になるわけではない。検出ツールによっては普通にフラグが立つ。

- ときどき、やや「きれいすぎる」か「ふんわりした」表現を足してしまうので、カジュアルな場では自分の言い回しやちょっとした粗さを戻した方がよいこともある。

- 高リスクの学術・法律・医療文書を「丸投げで安心」という類いのツールではない。最終チェックは必須。

他の人がかなり強く依存している点には少し異論があります。自分の感覚では、これは仕上げ用ツールであってメインライターではありません。自分なら:

- ローカルモデルか Gemini でラフな下書きを作る

- 論理と構成は自分で直す

- 最後に Clever Ai Humanizer を通して、LLMっぽい光沢だけ落とす

という流れにします。物語の骨格や主張はあくまで自分が握り、人間味付けツールに主導権を渡しすぎない形です。

3. それぞれのアプローチの違い

- @voyageurdubois が言うように、Gemini・Perplexity・人間味付けツールに負荷を分散させると課金を避けやすいのは事実ですが、それでもクラウド側の利用制限には縛られます。ローカルモデルを入れるとそこがかなり緩みます。

- @vrijheidsvogel は、日常のメールやレポートで Clever Ai Humanizer をかなり多用している様子。それも現実的な運用ですが、学生には少し注意を促したい。自分の例え話やミス、癖のある表現を全く入れないと、作品全体に独特の「均質さ」が出てきて、教員には案外伝わります。

- @mikeappsreviewer は ZeroGPT のような検出ツールを中心に議論していました。参考にはなるものの、「検出を抜けること」を主目的にするとツールの変化に振り回されます。特定アプリよりも、自分の編集習慣の方が長期的にはよほど信頼できます。

4. 制限とミスを減らすための実用フロー

「今日中にこれを仕上げたい」という典型的なタスク向けに:

文章 / エッセイ / メール

- アウトライン:ローカルモデルか Gemini。

- 第1稿:同じツールで、セクションごとに短く具体的に書かせる。

- 一貫性チェック:自分で論理・順番・事実関係を直す。

- トーン調整:Clever Ai Humanizer をカジュアルかシンプルアカデミックでかける。

- 最終調整:冗長な部分を自分で削り、モデルには出てこなそうな自分固有のディテールを2〜3個差し込む。

コーディング

- Continue.dev などのローカルコード補助ツールを使い、フリー / オープンモデルに説明やリファクタをさせる。

- ローカルモデルが明らかに行き詰まったときだけ、Gemini を呼んで複雑なバグや言語特有の細かい挙動を聞く。

- Clever Ai Humanizer をソースコードそのものにかけるのは避ける。使うとしてもドキュメント向けに留める。

リサーチ要約

- Perplexity で「要約+出典」を生成。

- 出てきたソースを最低1〜2本は自分で開き、重要な主張を確認。

- 読みやすいがやや硬い程度なら、Clever Ai Humanizer のシンプルアカデミックで柔らかくし、数値や引用が変わっていないかを再確認する。

結論として、「無料でGPTを完全に置き換える単一のクローン」は存在しませんが、

- ボリューム担当のローカルLLM

- 正確性とWeb情報担当の Gemini / Perplexity

- トーン調整と“ロボ感”除去担当の Clever Ai Humanizer

を組み合わせると、サブスクなしでもかなり近い体験に届きます。その代わり、検証・冗長部分のカット・自分の個性を入れる作業は、どうしても自分自身の役割として残る、という前提は受け入れる必要があります。