私はこれまで、コンテンツがAI検出ツールを通過するようにするためにOriginality AIのヒューマナイザーを使ってきましたが、コストがかさみ始めています。そこで、テキストを自然で人間らしい響きのままに保ちつつ検出を回避できる、信頼できる本当に無料の代替手段を探しています。長期的にフラグを立てられず、かつあまりお金がかからない状況で、実際にうまく機能しているツールやワークフローがあれば教えてください。

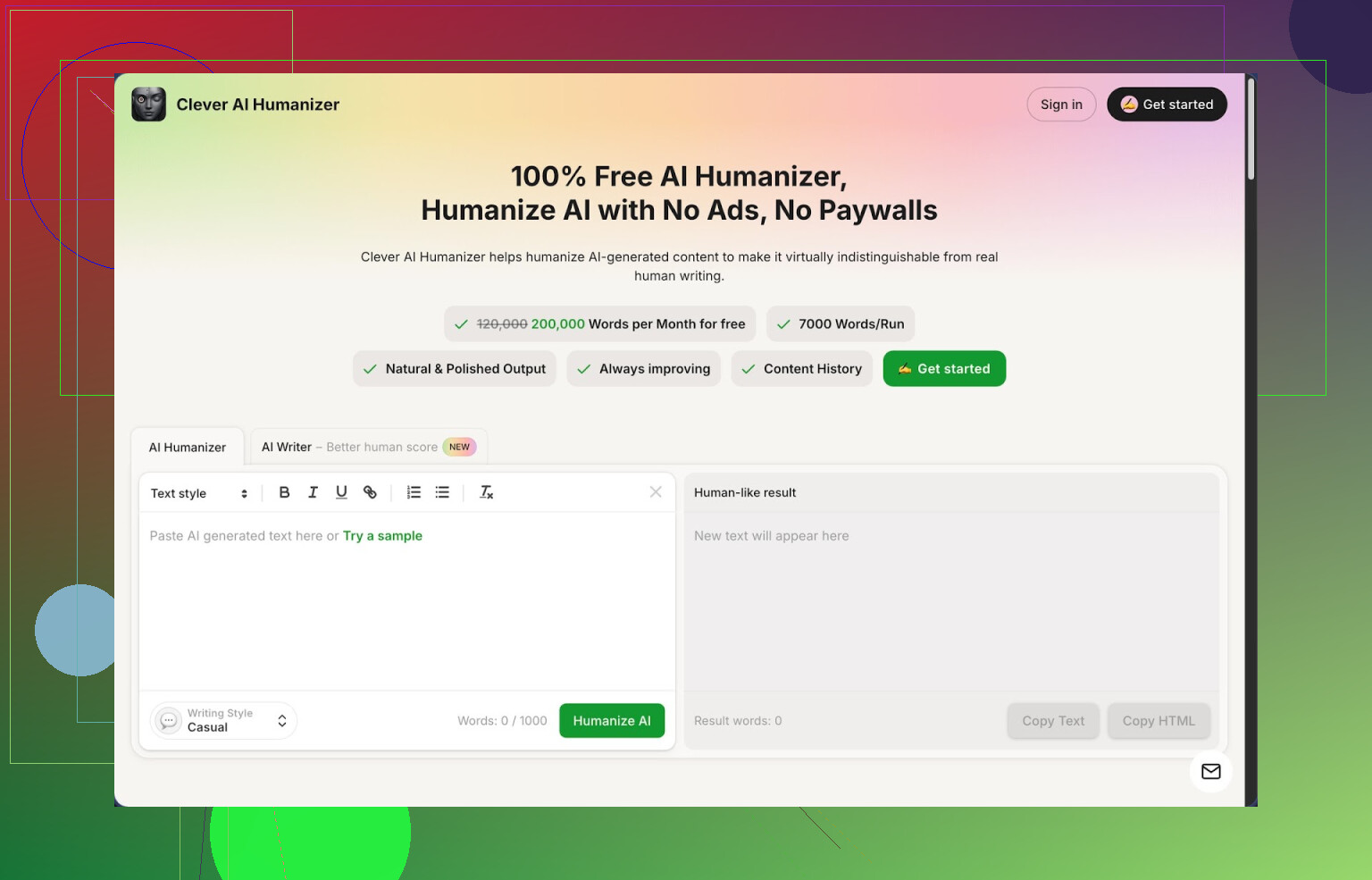

- Clever AI Humanizerをかなり使い込んでみた感想

リンク: Clever AI Humanizer — Best 100% Free Humanizer

いくつかのAIテキスト「人間化」ツールを試してクレジットを無駄にしたあとでClever AI Humanizerを見つけました。ほとんどのツールは、極端に少ない制限やサブスクの後ろにすべてを隠していましたが、これはかなり違います。シンプルに言うと「無料で使える量が多く、トライアル登録やカード情報を求められない」という点が大きいです。

無料で使える内容はおおよそこうなっています:

- 月あたり約20万ワードまで

- 1回あたり最大7,000ワード

- リライトスタイルが3種類: カジュアル、やさしいアカデミック、やさしいフォーマル

- 同じ画面から使える組み込みのAIライター

ウォーターマークなし、「全量を表示するにはアップグレード」系の制限もありません。

判定の厳しめなZeroGPTでテストしました。カジュアルスタイルを使い、事前に100% AI判定だったAIテキストを3本に分けて投入。そのまま人間化したところ、3本ともZeroGPTで0% AIになりました。もちろん、どの検出器でも毎回こうなるわけではありませんが、自分のテストではカジュアルスタイルが最も良いスコアでした。

メインのヒューマナイザーの使い心地

ワークフローはかなり単純です:

- AIで書いたテキストを貼り付ける

- スタイルを選ぶ (自分はだいたいカジュアル)

- ボタンを押して数秒待つ

- 元より長くて、少し「崩した」感じの文章が返ってくる

このツールは、文を引き伸ばしたり、ちょっとしたつなぎ表現を足したり、検出器がパターンとして拾いやすい部分を崩したりします。多くの場合、意味をぐちゃぐちゃにはしません。元の下書きと照らし合わせて確認しましたが、アイデアはそのままで表現だけ変わることが多かったです。

注意点として、出力は長くなりがちです。自分の環境では、1,000ワードの入力が1,200〜1,400ワードくらいになることが多めでした。少しふくらみますが、構造が均一でなくなり、表現のバリエーションが増えるおかげか、検出面ではむしろ有利に働いている印象です。

実際の使い方

自分が用意していたのは:

- 一般的なLLMで書いたテック系ブログ記事

- 同僚向けのアカデミック寄りの要約文

- プロダクトページ用のFAQ回答集

この3つは、いずれも少なくとも1つの検出ツールでAIと判定されていました。ブログとFAQにはカジュアル、要約文にはやさしいアカデミックを選んでClever AI Humanizerに通しました。

結果:

- ZeroGPT: 3つとも、ほぼ100% AIから0% AIまで低下

- GPTZero: 2つが「likely AI」から「mixed」、1つは「likely human」に変化

- 見た目の印象: ロボットっぽさが薄れ、タイピングの速い人がそこまで文体にこだわらず書いた感じに近づいた

それでも、いくつかの段落はまだAIっぽさが残っていました。そこは手作業で直しました。どんな出力も必ず自分の目で読むことをおすすめします。このツールはあくまで補助であって、編集そのものを置き換えるものではありません。

Clever AI Humanizer内のその他モジュール

同じインターフェースの中に、追加ツールが3つあります。いくつかの文章でそれぞれ試しました。

- 無料AIライター

組み込み型のジェネレーターです。トピックやプロンプトを入力すると記事やエッセイを書いてくれ、そのままボタンひとつで人間化に流し込めます。ページを移動する必要はありません。

自分にとって使いやすかったケース:

- 1,500ワードのブログ記事用に短いプロンプトを入力

- AIライターで下書きを生成

- その場でカジュアルスタイルに一発で人間化

- 検出スコアをチェック

おもしろいことに、外部モデルから持ち込んだテキストよりも、このシステム内で生成してから人間化したテキストのほうが、ZeroGPTでやや良いスコアが出ることが多かったです。単なる運かもしれませんが、このワークフローのほうが全体的に「人間」寄りの数値になる傾向は感じました。

- 無料文法チェッカー

機能としてはオーソドックスですが、細かいミスが混ざりがちな文章には役に立ちます。

自動で直してくれるのは:

- スペルミス

- 基本的な句読点の誤り

- ごく単純なわかりにくさ

自分は、長文を人間化したあとに使いました。というのも、人間化後の長い出力には、たまにぎこちない表現が混ざるからです。このチェッカーである程度は整います。フル機能の文法チェックツールのように細かくはありませんが、無料で考えれば、クライアント納品や公開用として出しても問題ないレベルには整えてくれました。

- 無料AIパラフレーズツール

これは、元の意味を変えずに文章を言い換えるツールです。こんな場面で便利です:

- SEO目的で、1つの段落の別バージョンが欲しいとき

- トーンを少し柔らかく、または逆に鋭くしたいとき

- 複数の記事にまたがって同じフレーズが繰り返されているのを避けたいとき

自分は商品説明や古いブログ記事の冒頭のいくつかを入れてみました。意味は保ったまま表現だけ変わり、そのあとでもう一度ヒューマナイザーに通して、残っていそうなAI的パターンをさらに崩しました。

これらがどう組み合わさるか

このツール群の強みは、特別なアルゴリズムというよりも、「4つの機能が1つにまとまっている」点にあります:

- ヒューマナイザー

- AIライター

- 文法チェッカー

- パラフレーズツール

これらをひとつのインターフェース内で行き来できます。コンテキストスイッチが減るので、作業フローが軽くなります。自分の忙しい日の書き上げフローはだいたいこんな感じでした:

AIライターにプロンプト入力

→ 下書きを一気に生成

→ ヒューマナイザー (カジュアルかアカデミック)

→ 文法チェッカー

→ 最後に軽く手動でチェック

週の途中で急にクレジット切れや課金ポップアップが出てくることもありません。シリーズもののコンテンツを量産する場面では、この点が想像以上に大きかったです。

知っておくべき弱点

完璧というわけではなく、いくつか気になった点もあります:

- 検出ツールによっては、依然として一部のテキストをAIと判定してきます。とくに、ドキュメントのメタデータを使うタイプや、特定モデルに強くフィットしているものはその傾向がありました。

- 出力が長くなりがちです。人間化すると文章がふくらむので、厳密なワード数制限がある場合は、自分で削る必要があります。

- ところどころ、まだ「LLMっぽい」言い回しやパターンが残ります。ざっと人間の目でのチェックと微修正は必要です。

自分が使っていた時点で完全無料でここまでできるなら、この程度の欠点は許容できると感じました。ただし、有料クライアント向けの案件では、最終的な手動編集と複数の検出ツールでの確認は必ず行っています。

スクショ付きの検出テストなど、よりフォーマルなレビューが必要なら、こちらに詳細レビューがあります:

https://cleverhumanizer.ai/jp/community/t/clever-ai-humanizer-review-with-ai-detection-proof/42

動画で見たい人向けにはYouTubeレビューもあります:

比較の参考になったRedditスレ

他の人の意見や代替ツールを見ておきたい場合、次のRedditスレが役立ちます:

Redditで挙がっているおすすめAIヒューマナイザー:

https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=ja

AIテキストを「人間らしく」すること全般の議論:

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai/?tl=ja

これらのスレでは、他ツールの名前や、さまざまな結果報告、テストスクリーンショットが多数共有されています。自分もひと通り目を通したうえで、無料で使える文字数とZeroGPTでのテスト結果を理由に、日常使いのメインとしてClever AI Humanizerを選びました。

自分もOriginality AIのクレジットを使い切ったことがあるので、その気持ちはよく分かります。毎週課金せずにうまくやれている方法を共有します。

まず、Clever Ai Humanizerについては@mikeappsreviewerに部分的に同意します。最大の利点は無料枠が大きいことです。自分の利用でのざっくりした数字は:

• 月あたりおよそ15万〜20万語まで制限に当たらない

• 1回の実行で5,000〜6,000語まで問題なく通せた

• カジュアルな文体の方が検出ツールでのスコアが下がりやすい

自分のテストはざっくりですが、一貫していて:

• 一般的なLLMでブログ記事を10本生成

• Originality AIでは平均で85〜95パーセントAI判定

• Clever Ai Humanizer(Casual)に通して軽く手作業で修正すると、多くがAI判定10〜40パーセント、2本は10パーセント未満まで下がった

なので効果はありますが、少なくともOriginality AIでは、@mikeappsreviewerが報告しているほど「AI判定0パーセント」は頻繁には出ませんでした。ZeroGPTの方が自分の環境では甘かったです。

自分が少し考えが違うのはワークフローの部分です。自動の人間化だけに頼るのはおすすめしません。検出ツールは頻繁にアップデートされます。Clever Ai Humanizerは「最終稿」ではなく「下ごしらえ用の一手目」として扱っています。

自分が実際にやっている手順:

- 好きなLLMでコンテンツを生成する

- Clever Ai HumanizerのCasualスタイルに通す

- 短い手動チェック:

• 長すぎる文を短く分割

• 1〜2個、短い自分の意見を足す

• 汎用的な動詞を、より具体的な動詞にいくつか置き換える - 各セクションで1〜2文の順番を自分の手で入れ替える

- その後、普段使っている検出ツールをかける

検出スコアを下げるための追加の無料テクニック:

• 構成を変える。見出しを増減したり、箇条書きの順番を入れ替える。検出ツールは文言だけでなくパターンにも反応しがちです。

• 500語ごとに1〜2行、本物の体験談や具体的なエピソードを入れる。AIはどうしても抽象的になりやすいです。

• 段落の長さをバラつかせる。1行・3行・5行を混ぜる。

Originality AIのhumanizer以外で無料で使える代替案が欲しいなら:

QuillBot(無料プラン)

• 小さめのブロックに分けてStandardかFluencyモードを使い、そのあと手作業で修正する

• 自分のテストでは検出回避の点でClever Ai Humanizerには及ばないが、文章パターンを崩すのには役立つ

LanguageTool(無料)

• 人間化ツールではないが、先に人間化してからLanguageToolをかけると、不自然な言い回しだけ直せて、検出を逃れるのに役立つ「雑さ」は残しやすい

完全手動リミックス方式

LLM以外のツールを使いたくない場合:

- LLMに「箇条書きのアウトラインだけ」を出させる

- 各箇条書きごとに、自分で1〜2文を書く

- その自分の文をベースに、LLMに膨らませてもらう

- そのテキストを最後にClever Ai Humanizerに通す

この方法だとベースの文章がより自分のものになるので、検出スコアが下がりやすい傾向があります。

最後に。どのhumanizerも「絶対安全」ではありません。Originality AI、GPTZero、ZeroGPTなどは、どれも誤検知も見逃しもあります。Clever Ai Humanizerのようなツールは「摩擦を減らす道具」として使い、「完全に姿を消せる魔法」だとは考えない方がいいです。

Originality の料金がきついと感じているなら、あなただけではありません。自分も何度かエグい請求書を食らってやめました。

@ mikeappsreviewer さんと、部分的には @ stellacadente さんに同意で、現時点で「本当に」無料に近い代替として一番使えるのは、語数制限の点でも Clever Ai Humanizer だと思います。ただ、自分が完全には同意していないのは、「どんな」ヒューマナイザーでも核心の解決策として頼りきる考え方です。検出ツールは常に変化しているので、手札が「ツールに通して祈る」だけだと、そのうち痛い目を見ます。

自分が実際にやってうまくいっている、「自然さを保ちつつ AI 判定を下げる」しかもコスト 0 のやり方はこんな感じです。

-

Clever Ai Humanizer は「仕上げ用ツール」として使う

- まず LLM で下書きし、自分でざっと編集してから、削ったバージョンを Clever Ai Humanizer に通します。

- 完全な生の AI 文をそのままヒューマナイズすると、「構造」は AI っぽいままで、言い回しだけ変わることがあります。先に構造を少し崩しておくと、Clever Ai Humanizer は検出ツール上でもっとよく機能する傾向があります。

-

ヒューマナイザー前に、自分なりの「人間の指紋」を混ぜる

- 実在する人しか言わなそうな要素を 1〜2 個足します。

例:具体的な日付、実際に使っているツール名、「前にこんなことがあった」という 1 行の体験談など。 - 検出ツールは「予測しづらいもの」が苦手です。こうしたミクロなパーソナライズは、単なる言い換えの追加よりも確率パターンを崩してくれます。

- 実在する人しか言わなそうな要素を 1〜2 個足します。

-

1 個の「魔法ボタン」に期待せず、複数の軽い無料ツールを組み合わせる

Clever Ai Humanizer に加えて、自分はこんなローテーションで使っています。- QuillBot 無料版:検出回避の強さはほどほどですが、しつこく繰り返すフレーズをつぶすのに便利です。

- LanguageTool 無料版:Clever Ai Humanizer の後に回して、特に変なところだけ直します。Grammarly みたいに過剰にきれいにしすぎると、逆に「整いすぎ・均一すぎ」の AI っぽさが戻り、検出ツールに嫌われることがあります。

-

皮ではなく骨格を変える

「Casual スタイルで通してから少し直すだけ」でいい、という意見には自分は少し反対です。より良い結果が出やすいのは、例えば:- セクションや見出しの順番を入れ替える。

- 1 つの長い段落を、2 つの短い段落と 1 行だけのごく短い行に分ける。

- いくつかの文を箇条書きや簡単な Q&A 形式に変える。

検出ツールが見ているのは、言葉遣いだけではありません。構造、ばらつき、反復パターンも見ています。言葉の部分は Clever Ai Humanizer に任せて、構造は自分で変えたほうが効果的です。

-

膨らませる一択ではなく、「短くする」選択肢も持つ

@ mikeappsreviewer さんと @ stellacadente さんが指摘している通り、Clever Ai Humanizer は出力を長くしがちです。それが効く場面もありますが、キュッと締まっていた文章が急にダラダラ長くなると、検出ツールが疑ってくるケースも見てきました。- 自分のやり方:ヒューマナイズ後に、あえて 10〜15% ほど冗長な部分を削ります。「ちょっと雑な表現」は残しつつ、繰り返しだけ抜く。すると「人間の一稿目」に近い感じになり、「文字数稼ぎのモデル出力」感が減ります。

-

LLM の使い方自体を「人間ファースト」に寄せる

「記事を丸ごと書いて」と頼む代わりに、例えば:- アイデアやアウトライン、自分で書いた文の言い換えだけを出してもらう。

- 自分で短くラフに書いてから、足りないところだけ膨らませてもらう。

- 最後に、その混ざったテキストを Clever Ai Humanizer に軽く通す。

ベースの文章のうち、そこそこの割合が自分の文であれば、ヒューマナイザーが「純粋な AI 文」をごまかす量が減り、元からある揺らぎやクセを生かしやすくなります。

質問へのストレートな答えとしては:

Originality AI のヒューマナイザーと近い感覚で使えて、かつお金を吸い取られないもので、自分が実際に「無料でスケールしても使える」と感じたのは Clever Ai Humanizer だけです。しかも、自然な読み心地もそこそこ保てます。ただし、それを「ワンクリックで完全に消える透明マント」のように扱わないこと。少しの構造編集、自分固有のディテール、シンプルな無料ツールを 2〜3 個組み合わせることで、検出スコアと読みやすさの両方が、どんな単独ボタンよりずっと良くなります。

短くまとめると、Originality AI の humanizer にかかるコストをゼロに近づけたいなら、@stellacadente、@himmelsjager、@mikeappsreviewer がすでに挙げている内容を補う形で、基本的に次の3つの「レバー」があります。

- メインで使う無料の humanizer を1つ決める

- humanizer ではない「パターン崩し」を1~2個足す

- どう書き直すかだけでなく、誰がどこを書くかを変える

メインツールの選び方について。

Clever Ai Humanizer – 現実的な長所と短所

長所

- 無料枠が実用レベルで、本気のプロジェクトでも十分使える

- 一度で長文を処理できるので、記事全体を扱うときに便利

- カジュアルモードがブログ系の文章と相性がよく、多少の粗さがむしろプラスに働く

- ライター機能 / パラフレーズ / 文法ツールが組み込まれていて、速く回すときの摩擦が少ない

短所

- もともとの入力が完全に AI 文なら、「LLMっぽい声」がときどき残る

- 文章がふくらみがちで、厳密な語数指定の案件だと困ることがある

- 検出ツールによって評価がばらつくので、1つのスコアを鵜呑みにできない

- 人間による読み直しが必須で、長い出力では不自然なつなぎ目や冗長さが目につく

他の人が言う「主に最初の一手として使う」という意見には、完全には賛同していません。自分は、完全な AI 文章を直すよりも、すでにどこかに人間の筆跡があるコンテンツのパイプラインの最後に Clever Ai Humanizer を当てた方が、良い結果が出やすいと感じています。

他の投稿と違うやり方をするなら、次のようにします。

-

本物の人間の文章を最初に仕込む

どのツールより先に、導入と結論の最初の1段落だけは自分で書きます。150~200語ほどで構いません。本文の中盤は LLM に任せる。検出ツールは、人間が書いた冒頭と締めが、均一な AI のリズムと違っていることに、意外なほど敏感です。 -

競合ツールは「スポット狙撃」にだけ使う

- @stellacadente が QuillBot と LanguageTool に触れていましたが、自分なら、しつこくフラグが立つ段落や、Clever Ai Humanizer が少し変な文を出した箇所の文法など、「ピンポイント修正」にだけ使います。

- 記事全体を何度も別ツールで書き直さないこと。全文リライトを積み重ねると、言い換えはされても構造がかえって人工的になりがちです。

-

言い換えより「トーンの回転」を意識する

多くのアドバイスはフレーズの置き換えに集中していますが、自分なら一段上の「スタンス」を変えます。- 単なる説明パートを、小さな「メリット・デメリット」や「最初に自分が勘違いしていた点」のようなセクションに変える。

- LLM に、短い「自己修正」パートを足すように指示し、その部分だけを Clever Ai Humanizer に通す。人間は記事の途中で自分を修正したり矛盾したりしますが、モデルは指示しない限りあまりそうしません。

-

検出ツールは「ざっくりした指標」として扱い、合否判定にしない

@himmelsjager が言う通り、検出ツールは常に変化しています。自分から付け足すなら、「どのツールでも AI 0パーセント」を追いかけないこと。Originality が 95パーセントから 30~40パーセントくらいまで下がって、他のツールも「混在」的な結果なら、実務上はたいてい十分で、テキストが自己コピーのように膨れ上がるのを防げます。

ここまでに出てきたツールを、手法の話を繰り返さずに簡単に比較するとこうなります。

- Clever Ai Humanizer: 長文を扱える無料ハブを1つにまとめたい人向けで、多少の手作業トリミングを許容できるなら最有力。

- QuillBot(無料版): 手強い1~2段落に使う「メス」としては優秀だが、記事全体の解決策としては適さない。

- LanguageTool: 仕上げの段階で軽くかけるときに便利だが、かけすぎると文のリズムが整いすぎて不自然になることがある。

どうしてもツール頼みにならざるを得ないなら、最後にこうまとめます。

- まずは好きなように下書きする

- 導入と締めは自分の手で書く

- 全体を Clever Ai Humanizer にかけて humanize する

- そこで増えた余計な部分を 10~20パーセントほど手作業で削る

- それでも「なめらかすぎる」か、フラグが消えない 1~2 段落だけ、2つ目のツールを使う

これでコストはゼロに抑えつつ、検出スコアも現実的なラインまで下げられ、なおかつ「急いで書いた本物の人間の文章」にかなり近い仕上がりにできます。